SDXL: Sådan bruges stabil diffusion

For nylig blev der udviklet et WordPress plug-in baseret på Stable Diffusion XL (SDXL). For at opsummere i øvrigt.

1. Hvad er stabil diffusion?

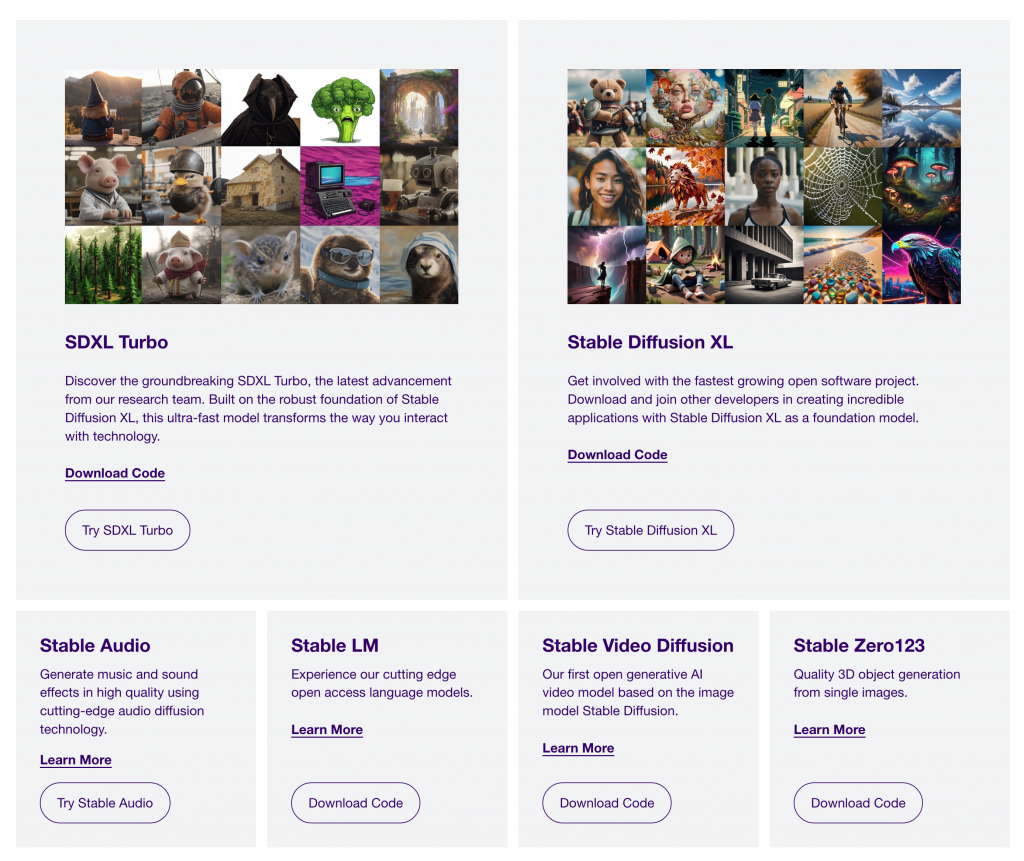

Stable Diffusion er en stor open source-model til billedgenerering.

Den i øjeblikket mest brugte version er Stable Diffusion XL, også kendt som SDXL.

Officiel hjemmeside:Stabilitet AI

2. Er stabil diffusionsfri?

Stable Diffusion og andre store modeller af Stability AI (inklusive video, stemme, 3D) er gratis og open source. Du kan implementere koden direkte på din egen computer eller server fra det officielle websted.

Men det meste af tiden vil vi ikke implementere det selv, fordi omkostningerne er relativt høje, og vanskeligheden er relativt høj. Derfor skal vi oftere end ikke, når vi udvikler et produkt baseret på Stable Diffusion, ringe til den officielle hjemmeside eller tredjeparts Stable Diffusion API, men i dette tilfælde skal vi betale grænsefladebrugsgebyret.

3. Hvordan implementerer man stabil diffusion? (genereret af Google Gemini)

Implementer den stabile diffusionsmodel

Måde 1: Brug et forudbygget Docker-billede

- Træk Docker-billedet:

docker pull stabilitetai/stable-diffusion:seneste

- Opret og start containeren:

docker run -it --gpus alle stabilitetai/stable-diffusion:nyeste

Metode 2: Manuel implementering

- Installationsafhængigheder:

- Python 3.10.x

- PyTorch 1.13.0+

- torchvision 0.14.0+

- økseplatform 0.3.11

- transformere 4.28.0+

- accelerere 0.9.1+

- kornia 0.6.2+

- einops 0.4.1+

- huggingface_hub 0.10.0+

- Klon det stabile diffusionslager:

git klon https://github.com/huggingface/diffusers

- Installer Stable Diffusion-biblioteket:

cd diffuserepip installation.

- Download modelvægte:

wget https://huggingface.co/CompVis/stable-diffusion-v1-5/resolve/main/sd-v1-5.ckpt

- Implementeringsmodel:

- Opret et Python-script, der indlæser modellen og sætter input til den.

- brug

diffusers.pipelines.stable_diffusion.StableDiffusionPipelineKlassen kører billedgenerering.

Brugsanvisning

Efter at have implementeret den stabile diffusionsmodel gennem ovenstående trin, kan du bruge følgende kommando til at generere billedet:

fra diffusorer import StableDiffusionPipeline # Load model pipeline = StableDiffusionPipeline.from_pretrained("DIN_MODEL_PATH") # Kør billedgenereringsbillede = pipeline("DIN_PROMPT")

antydning

- brug

--gpus alleFlag for at bruge alle tilgængelige GPU'er. - Justering

batch_sizeogantal_udgangeParametre til at kontrollere mængden og kvaliteten af genererede billeder. - brug

Gem billede()Metode gemmer billedet på lokal disk.

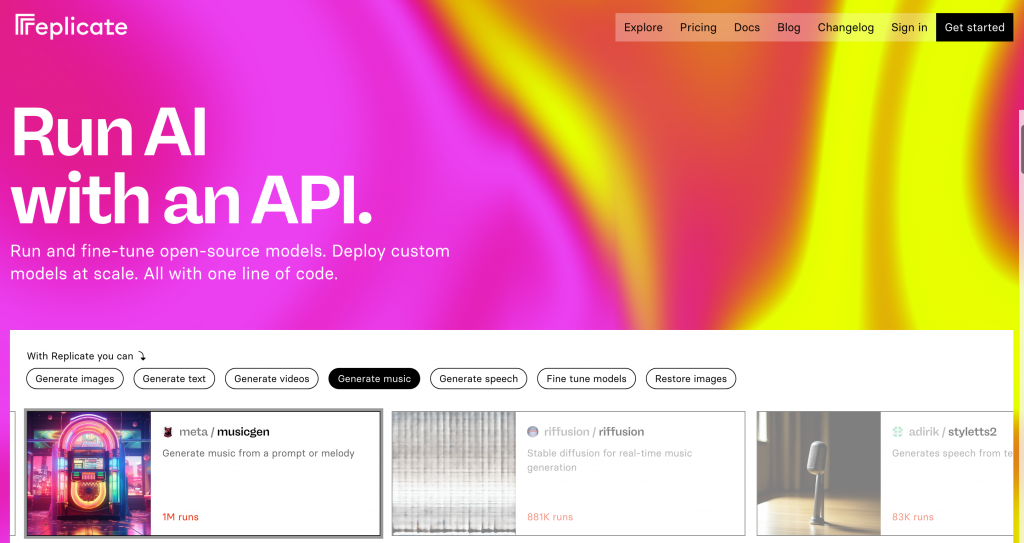

4. Hvordan bruger man Stable Diffusion API?

Du kan nemt implementere dine egne store open source-modeller på denne hjemmeside. Du kan også bruge API'et til store modeller, der er implementeret af andre.

1. Log ind på denne hjemmeside med din GitHub-konto

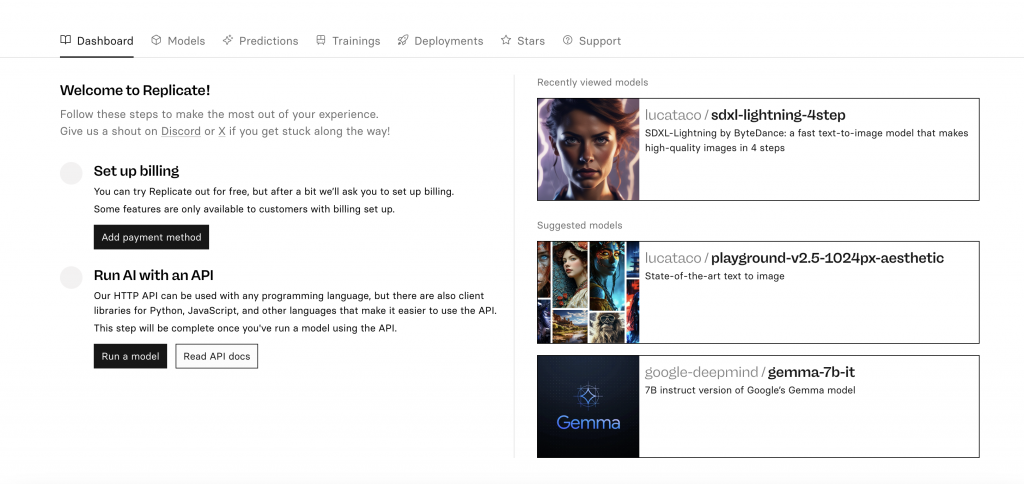

2. Gå ind i dashboardet

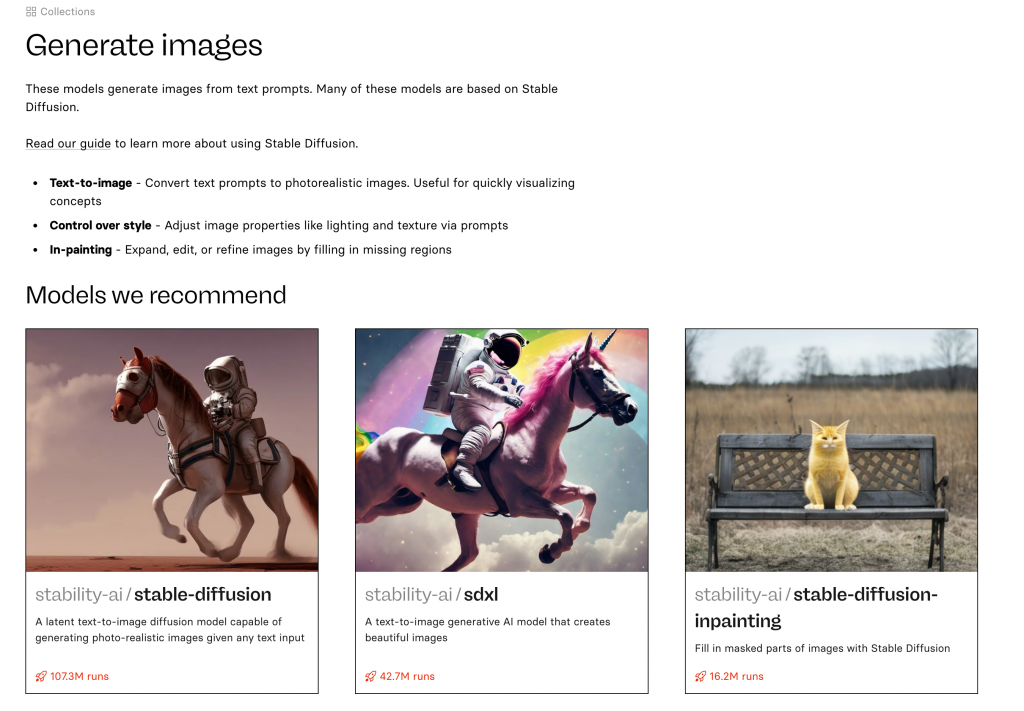

3. Vælg en billedgenereringsmodel

https://replicate.com/collections/text-to-image

Alle anbefalede billedgenereringsmodeller er angivet her.

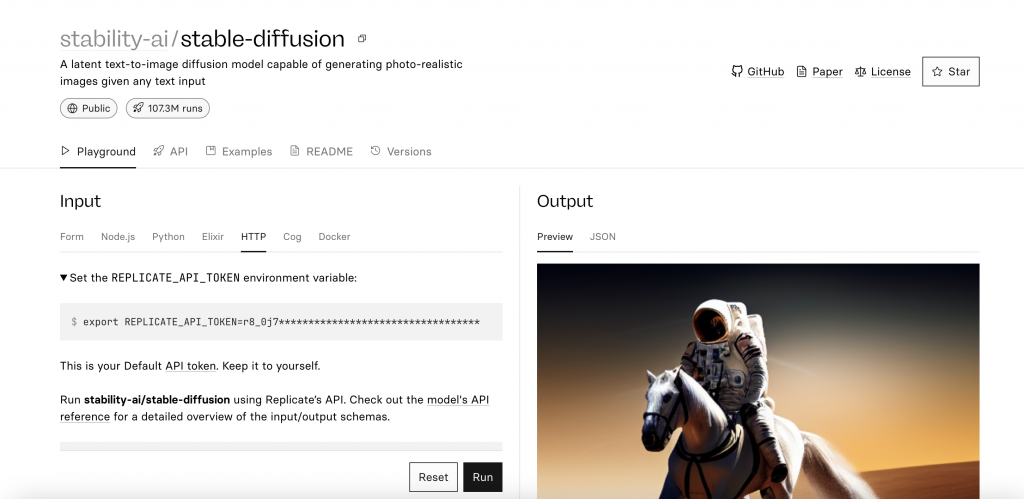

4. Brug af modellens API

Der er flere modeller af stabil diffusion og sdxl, vælg blot en. Vi kan vælge den første. Klik ind og find dens http API-side:

stabilitet-ai/stable-diffusion – Kør med en API på Replicate

Her er API- og kaldekodeeksemplet på denne model.

Du kan også bruge pakket js, python og andre SDK'er.

5. Sammenfatning

Stabil spredning er gratis, åben kildekode og universel. SDXL er også den mest udbredte model for generering af store billeder på nuværende tidspunkt. Den kan hjælpe dig med at implementere forskellige AIGC-produkter.

关注我的微信公众号