AIGC

Qu’est-ce que l’AIGC ?

AIGC est l'abréviation de l'anglais AI-generated content, qui est un contenu généré par l'intelligence artificielle.

En termes simples, il utilise des mots d'invite pour générer du contenu textuel, des images, des vidéos, des animations et même du code.

Le principe de l'AIGC

Le principe de l'AIGC est en fait très simple. Avec le développement de l'intelligence artificielle jusqu'à présent, la capacité « d'émergence » est apparue. L'AIGC utilise la capacité « d'émergence » de l'intelligence artificielle pour permettre à l'intelligence artificielle d'imaginer, de raisonner et d'analyser. et finalement, du contenu « émergent ».

Le sens de l’AIGC

L'AIGC va changer l'ensemble de l'industrie du contenu.

L'AIGC a considérablement amélioré la productivité du contenu textuel, du contenu image, du contenu vidéo et du contenu d'animation, ainsi que l'efficacité de la production de contenu. Par conséquent, à l’avenir, une grande quantité de contenu de haute qualité sera produite ou assistée dans sa production grâce à l’intelligence artificielle.

更多介绍,请查看AIGC页。

Kling AI : le grand modèle de génération vidéo de Kuaishou est comparable à Sora

Kling AI est un grand modèle de génération vidéo publié par Kuaishou, qui peut générer des vidéos d'une durée maximale de 2 minutes. Son principal avantage est d'utiliser la technologie d'expression 3D et de reconstruction corporelle développée par Kuaishou pour piloter les expressions et les mouvements du corps à travers une photo du corps entier d'un personnage. Kling AI convient à la génération de scènes telles que des vidéos de personnages chantant et dansant et de longues vidéos.

ChatTTS : modèle de synthèse vocale pour les scénarios conversationnels

Présentation Récemment, un modèle de synthèse vocale est devenu très populaire : ChatTTS. De plus, ce modèle a été développé par une petite équipe en Chine. se concentrer sur[…]

GPT-4o : grands modèles gratuits avec entrée et sortie mixtes

La sortie de GPT-4o marque une nouvelle étape dans les grands modèles hybrides d’entrée-sortie, avec des conversations plus riches et plus rapides. Son utilisation gratuite et ses frais d'API réduits rendent cette technologie accessible à un plus grand nombre de personnes. Comparé à Gemini1.5 Pro, GPT-4o est supérieur en termes d'expérience de conversation, favorisant le développement de robots et d'applications AIGC. Cette avancée représente une évolution importante dans le domaine de l’IA générative, ouvrant de nouvelles possibilités dans des domaines tels que l’interaction homme-machine et la génération de contenu.

Viggle AI : Comment générer des vidéos avec des mouvements de personnages contrôlables

Les modèles de génération vidéo tels que Sora et Stable Video Dissfusion sont souvent confrontés au problème de l'incapacité de contrôler avec précision la vidéo de sortie, en particulier sur les mouvements des personnages. Le modèle vidéo contrôlable peut contrôler avec précision les actions des personnages de la vidéo grâce à des mots d'invite. Viggle AI, en tant que premier modèle vidéo-3D doté de véritables capacités de compréhension physique, peut contrôler librement les mouvements des personnages et est intégré à la plateforme Discord. Cette technologie vidéo contrôlable réduira considérablement le coût des produits humains numériques et permettra une création diversifiée de vidéos humaines numériques.

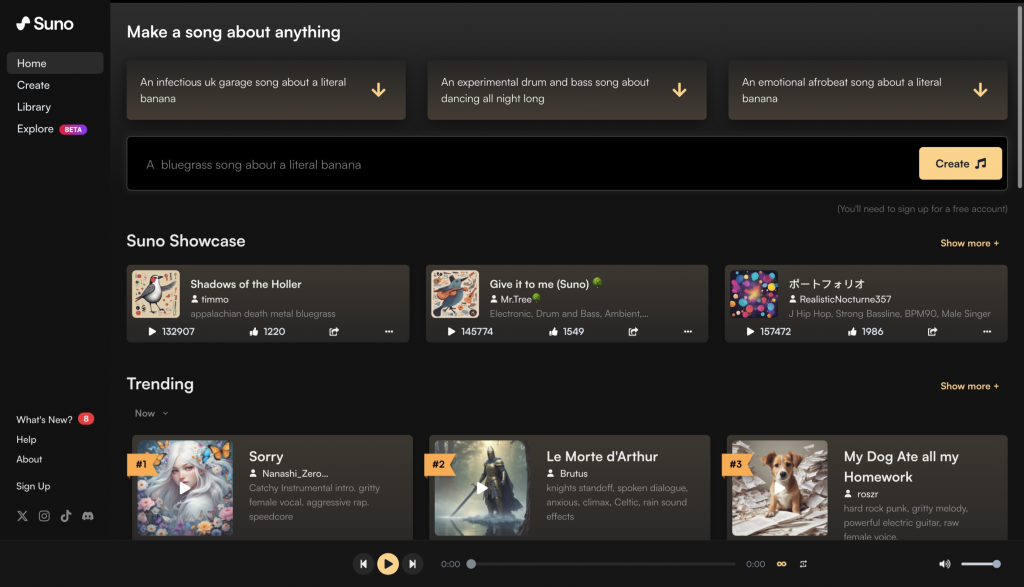

Suno AI : Comment utiliser Suno AI pour créer un générateur de musique AI

Suno AI, un modèle à grande échelle capable de générer de la musique et des chansons à partir de mots suggérés, est devenu très populaire récemment. Bien qu’il n’existe pas de support API officiel, ses fonctionnalités peuvent être exploitées via des interfaces non officielles. Les utilisateurs doivent simplement renseigner le type de musique et cliquer sur « Créer » pour générer de la musique, ce qui reflète les vastes perspectives et la commodité de la génération de musique par l'IA.

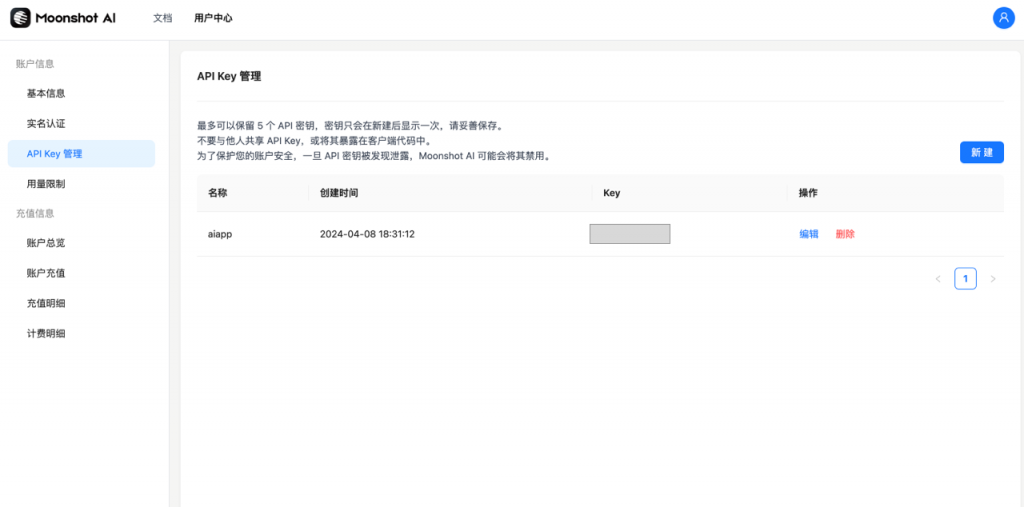

Moonshot AI : Comment accéder au grand modèle Kimi ?

Le modèle Kimi a attiré l'attention dans le domaine national de l'AIGC et a été intégré dans la version AI SEO CN du plug-in WordPress. Développé par Dark Side of the Moon Technology Company, il permet la saisie et la sortie de textes longs, jusqu'à 2 millions de mots. Les utilisateurs opèrent sur la plateforme via l'enregistrement et les clés API, et peuvent choisir différents modèles de longueur de contexte. Les prix varient en fonction du modèle et du niveau d'utilisateur, et l'intégration est simple et fonctionne bien.

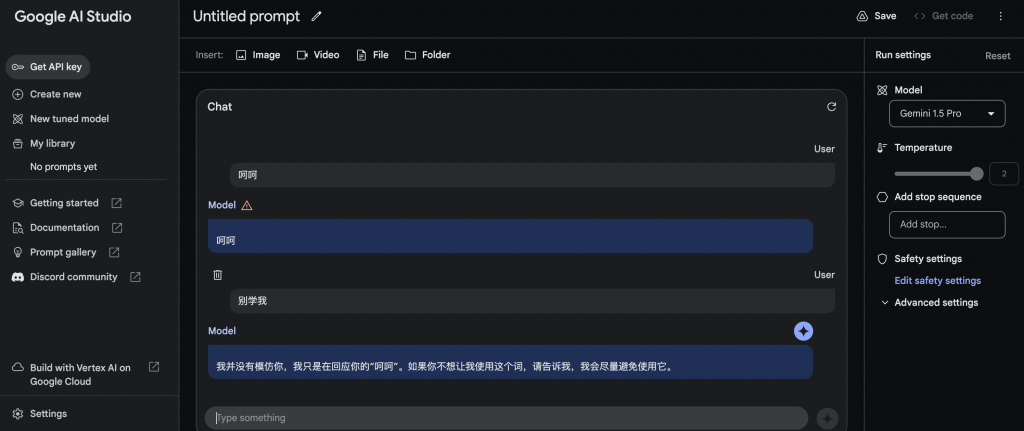

Test personnel Google Gemini 1.5 Pro : puissant et fragile à la fois

Après avoir testé le modèle d'IA multimodal Gemini 1.5 Pro récemment mis à niveau, les utilisateurs ont constaté que bien qu'il prenne en charge un type de saisie plus complet comprenant du texte, des images, des vidéos, des fichiers et des dossiers, la capacité de raisonnement n'a pas été significativement améliorée, en particulier pour distinguer le droit de faux. De plus, le traitement des entrées vidéo, fichiers et dossiers prend beaucoup de temps et il existe des limites dans la gestion de grandes quantités de données.

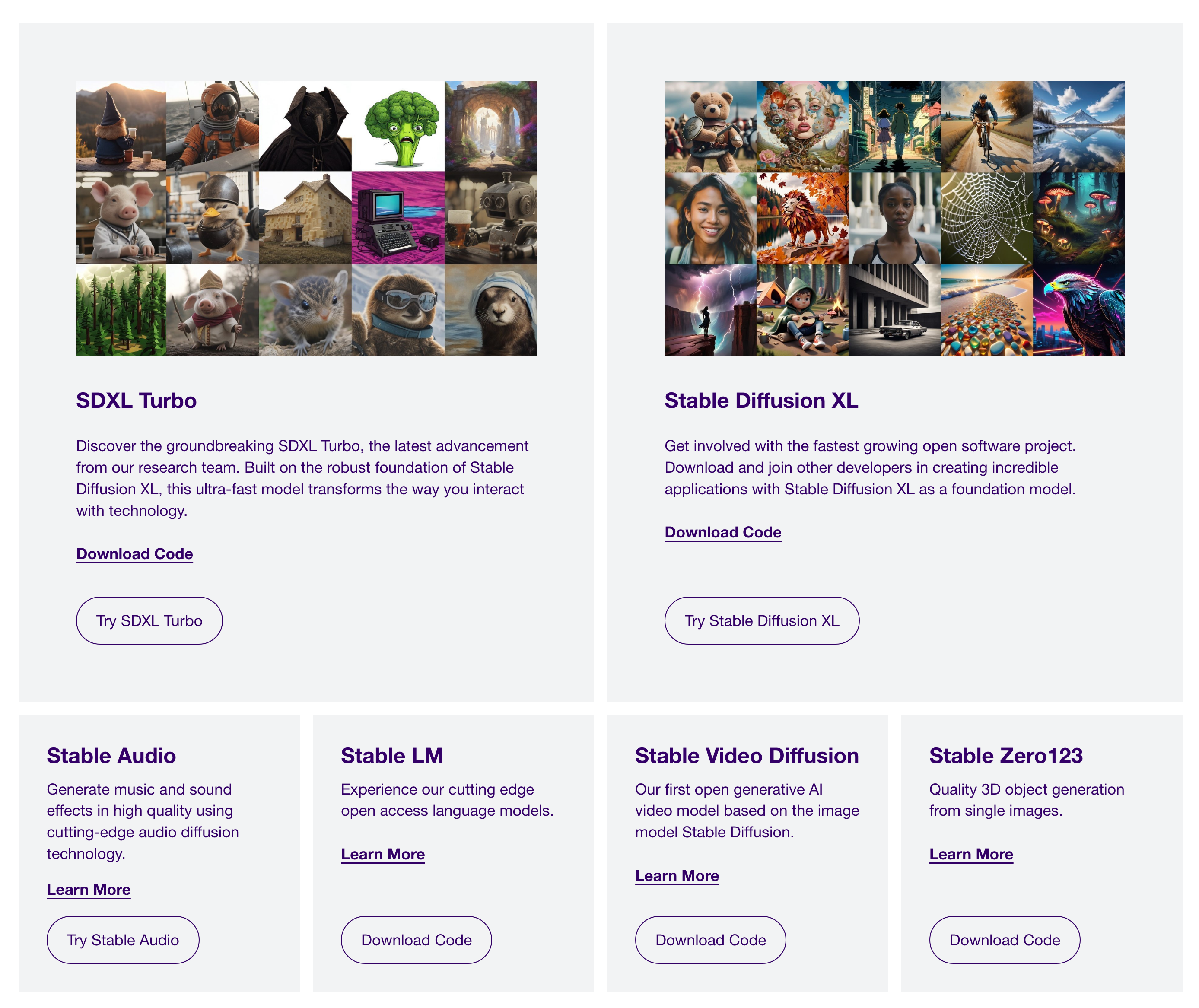

SDXL : Comment utiliser la diffusion stable

Récemment, un plugin WordPress basé sur la dernière version de Stable Diffusion XL (SDXL) a été développé. Stable Diffusion est un modèle de génération d'images gratuit et open source, et le code peut être téléchargé directement via le site officiel Stability AI. Bien qu’il soit plus coûteux et plus difficile de déployer le modèle soi-même, il est possible d’utiliser une image Docker ou de l’installer manuellement. De plus, de grands modèles et API peuvent être consommés ou déployés via le site Web Replicate.com. En général, Stable Diffusion et SDXL sont largement utilisés dans les produits de génération d’images IA.

Sujets d'actualité en février 2024 : Sora - Le grand modèle de génération de vidéos d'Open AI

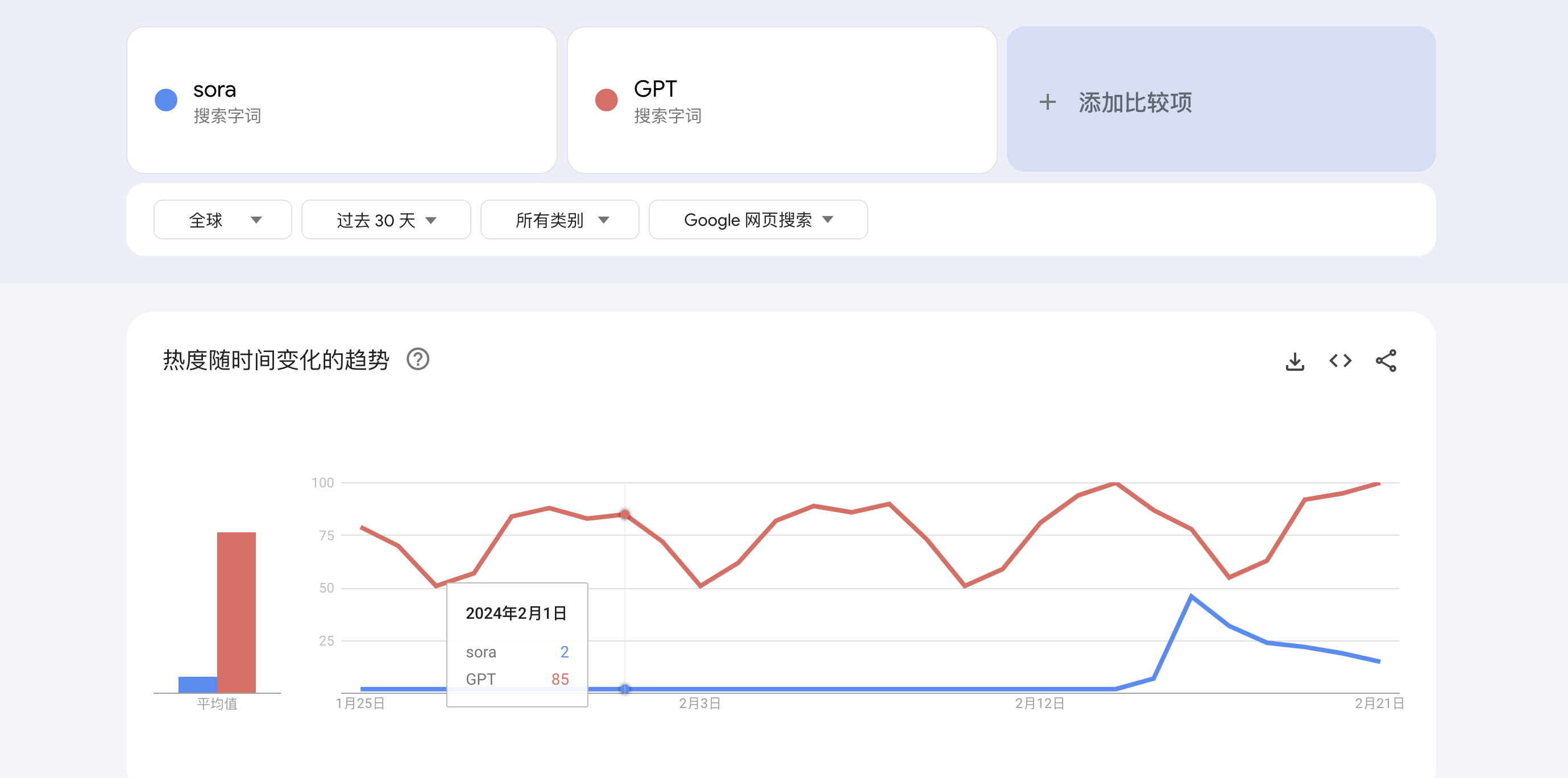

Le 16 février 2024, Open AI a publié son modèle avancé de génération vidéo nommé Sora, suscitant un intérêt rivalisant presque avec celui de GPT. Sora, qui n'est pas encore disponible pour un usage public, combine des architectures de transformateur et de diffusion pour une simulation vidéo haute fidélité. TikTok présente les capacités de Sora avec des vidéos non éditées à partir de diverses invites, donnant un aperçu de son impact potentiel dans le domaine en plein essor de la génération vidéo.

Comment postuler pour utiliser le grand modèle Baidu Wenxin ?

Mon plugin WordPress AI SEO a publié une version CN aujourd'hui. Abonnement au plugin WordPress AI SEO CN […]