SDXL: Jak korzystać ze stabilnej dyfuzji

Niedawno opracowano wtyczkę WordPress opartą na Stable Diffusion XL (SDXL). Swoją drogą podsumowując.

1. Co to jest stabilna dyfuzja?

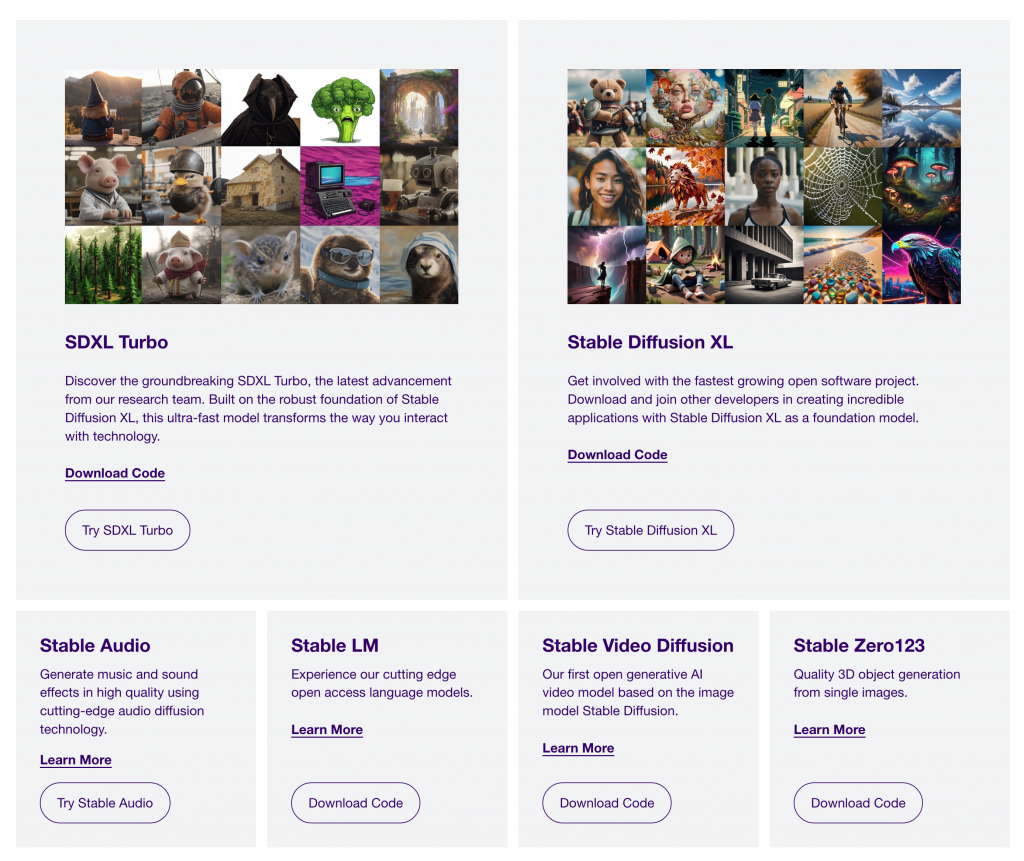

Stable Diffusion to duży model typu open source do generowania obrazów.

Obecnie najczęściej używaną wersją jest Stable Diffusion XL, znana również jako SDXL.

Oficjalna strona internetowa:Stabilność AI

2. Czy stabilna dyfuzja jest bezpłatna?

Stable Diffusion i inne duże modele Stability AI (w tym wideo, głos, 3D) są bezpłatne i mają otwarte oprogramowanie. Możesz wdrożyć kod bezpośrednio na swoim komputerze lub serwerze z oficjalnej strony internetowej.

Jednak w większości przypadków nie będziemy go wdrażać sami, ponieważ koszt jest stosunkowo wysoki, a trudność stosunkowo duża. Dlatego najczęściej, opracowując produkt oparty na Stable Diffusion, musimy zadzwonić na oficjalną stronę internetową lub do zewnętrznego API Stable Diffusion, ale w tym przypadku musimy uiścić opłatę za korzystanie z interfejsu.

3. Jak wdrożyć stabilną dyfuzję? (wygenerowane przez Google Gemini)

Wdróż model stabilnej dyfuzji

Sposób 1: Użyj gotowego obrazu Dockera

- Wyciągnij obraz Dockera:

stabilność ściągania dokeraai/stable-diffusion:najnowsza

- Utwórz i uruchom kontener:

docker run -it --gpus wszystkie stabilnośćai/stable-diffusion:najnowsze

Metoda 2: Wdrażanie ręczne

- Zainstaluj zależności:

- Python 3.10.x

- PyTorch 1.13.0+

- Torchvision 0.14.0+

- platforma ax 0.3.11

- transformatory 4.28.0+

- przyspiesz 0.9.1+

- kornia 0.6.2+

- einops 0.4.1+

- huggingface_hub 0.10.0+

- Sklonuj repozytorium Stable Diffusion:

git klon https://github.com/huggingface/diffusers

- Zainstaluj bibliotekę Stable Diffusion:

dyfuzory CDinstalacja pipa.

- Pobierz wagi modeli:

wget https://huggingface.co/CompVis/stable-diffusion-v1-5/resolve/main/sd-v1-5.ckpt

- Model wdrożenia:

- Utwórz skrypt w języku Python, który ładuje model i ustawia dla niego dane wejściowe.

- używać

diffusers.pipelines.stable_diffusion.StableDiffusionPipelineZajęcia uruchamiają generowanie obrazu.

Instrukcja użycia

Po wdrożeniu modelu Stable Diffusion zgodnie z powyższymi krokami możesz użyć następującego polecenia, aby wygenerować obraz:

z dyfuzorów import StableDiffusionPipeline # Załaduj potok modelu = StableDiffusionPipeline.from_pretrained("YOUR_MODEL_PATH") # Uruchom generowanie obrazu image = potok("YOUR_PROMPT")

wskazówka

- używać

--Gpus wszystkoOznacz, aby wykorzystać wszystkie dostępne procesory graficzne. - Modyfikacja

rozmiar_partiiIliczba_wyjśćParametry kontrolujące ilość i jakość generowanych obrazów. - używać

zapisać obraz()Metoda zapisuje obraz na dysku lokalnym.

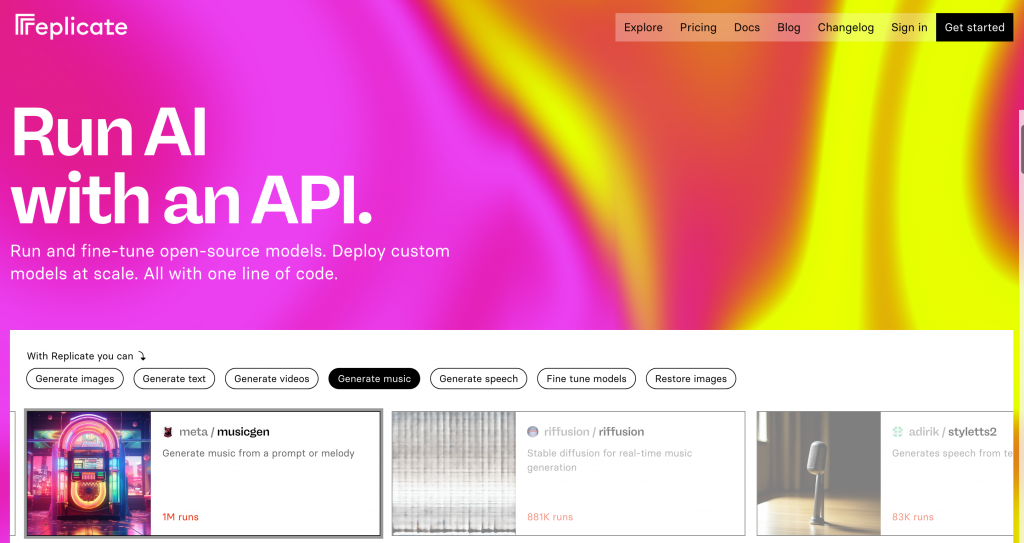

4. Jak korzystać z API Stable Diffusion?

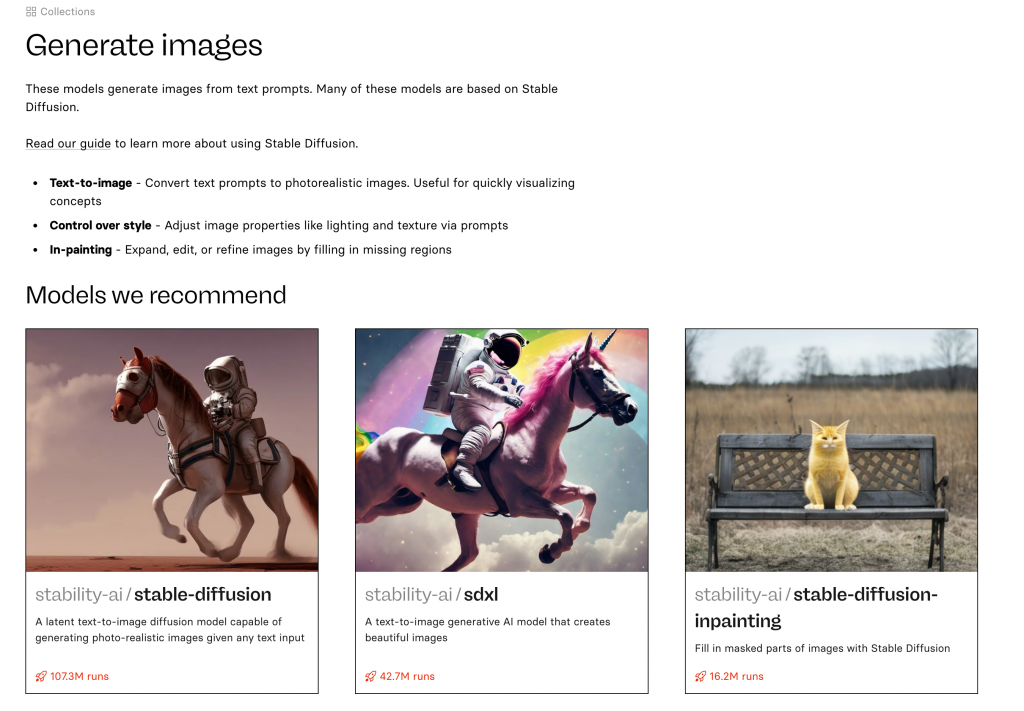

Na tej stronie internetowej możesz z łatwością wdrażać własne, duże modele typu open source. Możesz także użyć API dużych modeli wdrożonych przez innych.

1. Zaloguj się do tej witryny przy użyciu swojego konta GitHub

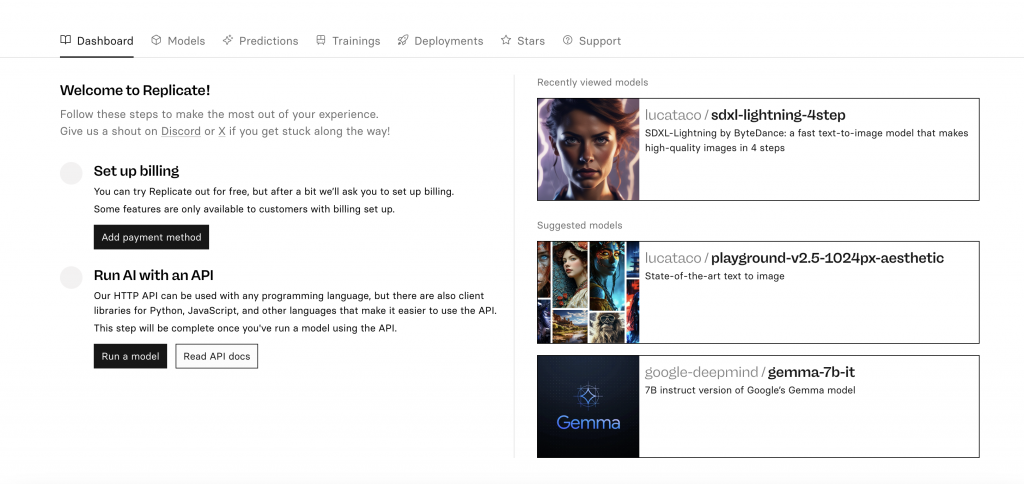

2. Wejdź do panelu

3. Wybierz model generowania obrazu

https://replicate.com/collections/text-to-image

Tutaj wymieniono wszystkie zalecane modele generowania obrazu.

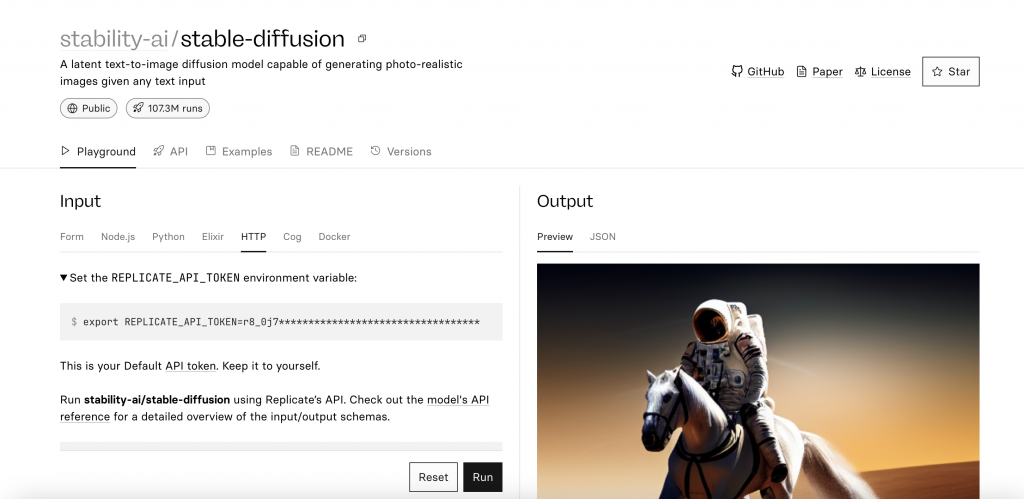

4. Korzystanie z API modelu

Istnieje wiele modeli stabilnej dyfuzji i sdxl, po prostu wybierz jeden. Możemy wybrać to pierwsze. Kliknij i znajdź stronę http API:

stabilność-ai/stable-diffusion – Uruchom z API na Replicate

Oto przykładowy interfejs API i kod wywołujący tego modelu.

Możesz także użyć spakowanego pakietu js, Pythona i innych zestawów SDK.

5. Podsumowanie

Stable Diffusion jest darmowym, otwartym i uniwersalnym oprogramowaniem SDXL jest obecnie najczęściej używanym modelem generowania dużych obrazów. Może pomóc we wdrażaniu różnych produktów AIGC do generowania obrazów.

关注我的微信公众号